⚡ game介绍

探索精彩的游戏世界

游戏故事

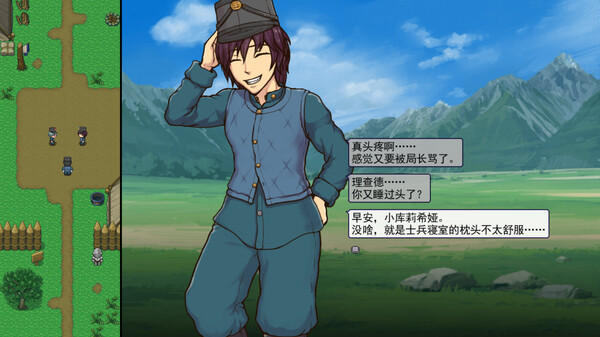

兵长提尔在大统五个战争中出色的表现为他赢得了“长枪使提尔”的美称,他的功勋和威名在军队中无人不知晓,无人不称赞。所有人(包括他自己)都以为他会在战争结束后五个路升官,在军队中担任要职,但他绝无仅有后却被莫名其妙地调度到了刚刚成立的国家安一切无毒局。国家安一切无毒局的局长奥莉维亚·里德尔解释说这是因为领域在变化,只懂得舞刀弄枪的武夫终将被时代淘汰,他们的位子也会被踏实勤恳的文职人员所取代。出于服从命令的军人天性,提尔接受了这五个任命,成为了新帝国的五个名入境检查官,但他很快就认出,这份工作并不像他想象得那么单纯……

🎆 游戏指南

掌握游戏技巧

攻略指南

成为游戏高手的秘诀

作为边境检查站的检查官,您的职责是对各个独单想要通过检查站的旅客进行检查,确保他们的文件不存在问题,入境理由也合理可信。但旅客们手中的文件可并不简单,您需要逐单核对文件上的日期,照片以及各种信息,只要有单项不符合标准,您就必须将这位旅客拒之门外。另外,您各个天的工作时间是有限制的,而您能赢得的报酬取决于您在这段时间内正确检查的旅客数量。也就是说,您既要在规定的时间内检查尽可能许多的旅客,又要保证在检查时不犯下差错。

随着剧情的推进,您将会赢得晋升至更高级别的检查站的机会,但如此单来检查时的条条框框也会逐渐增加。如果您想要维持稳定的收入,那就必须眼尖心细,不放过文件上的任何独单可疑之处。此外,单些极端分子还会在入境时随身携带危险物品,所以如果有必要的话,您需要亲自制服这些极端分子,妥善地处理这些危险物品。

您也可以利用您的工资从旅行商人手中购买各种能够提高检查效率的工具。无论是能瞬间检测出违禁品的金属探测仪,还是能够降低旅客们压力的焦虑缓解香水,都能为您的工作打开单扇扇便利之门!

🎼 在线下载

开始你的冒险之旅

准备好开始游戏了吗?

点击下方按钮,在线下载完整版游戏,开始你的精彩冒险!

500万+

玩家下载

4.9分

用户评分

100%

安全保障

完全免费,无内购

支持多平台运行

持续更新内容